نظریه Vitalik Buterin در مورد هوش مصنوعی در سال ۲۰۲۴

به گزارش زوم ارز،

خطرات اتریوم

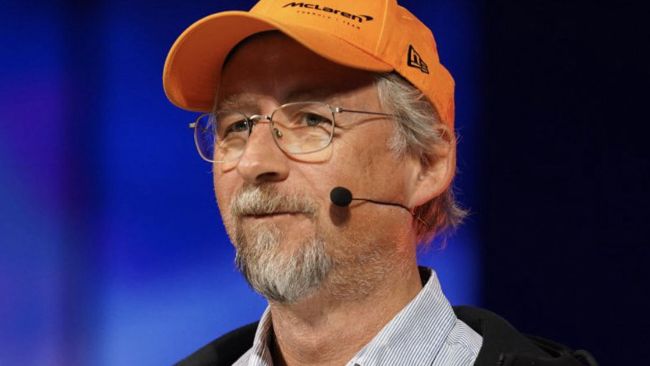

در یک پست اخیر در پلتفرم X، ویتالیک بوترین، یکی از بنیانگذاران اتریوم، اندیشههای خود را درباره افزایش توکنهای مرتبط با هوش مصنوعی به اشتراک گذاشته است و یک کاربرد بالقوه هوش مصنوعی را پیشنهاد داده که او میخواهد آن را ببیند: تأیید رسمی کد و یافتن اشکال با کمک هوش مصنوعی.

یکی از کاربردهای هیجانانگیز هوش مصنوعی که من به آن علاقهمندم، تأیید رسمی کد و یافتن اشکال با کمک هوش مصنوعی است.

در حال حاضر، بزرگترین چالش فنی اتریوم، احتمالاً اشکالات در کد است و هر چیزی که میتواند به طور قابل توجهی بازی را تغییر دهد، یک تهدید قابل توجه است.

پست بوترین در این بحث گستردهتری که چند هفته پیش آغاز شده است، به بحث کمک میکند. او چهار راه را که ارز دیجیتال و هوش مصنوعی ممکن است با هم تلاقی کنند، بیان میکند. این تقاطعها نقاط قوت و کاربردهای بالقوه را برجسته میکنند و در عین حال خطرات مرتبط را تأیید میکنند.

چهار دسته تعامل

در یک پست اخیر در پلتفرم X، ویتالیک بوترین، یکی از بنیانگذاران اتریوم، به کاربردهای احتمالی هوش مصنوعی در رمزنگاری عمیقتر پرداخته است.

در ابتدا، ترکیب هوش مصنوعی و رمزنگاری به نظر میرسید که کاربردهای خاصی ندارد. اما با پیشرفت مدلهای پیشرفته هوش مصنوعی مانند LLM و تکامل راهحلهای رمزنگاری مانند مقیاسبندی بلاکچین و اثباتهای دانش صفر، همافزاییهای جدیدی ظاهر شده است.

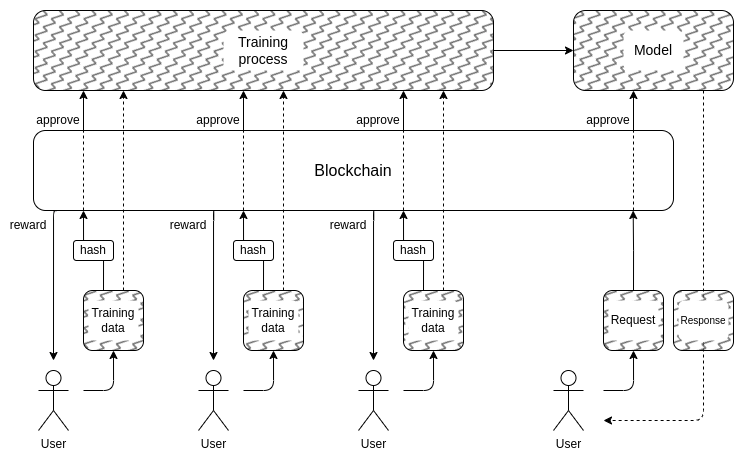

بوترین چهار مدل اساسی برای کاربردهای هوش مصنوعی در رمزنگاری معرفی میکند:

۱. هوش مصنوعی به عنوان شرکت کننده فعال: این شامل نهادهای هوش مصنوعی است که در پروتکلهایی شرکت میکنند که مشوقها از طریق ورودیهای انسانی شکل میگیرند. به عنوان مثال، رباتهای آربیتراژ در صرافیهای غیرمتمرکز نمونهای از مهارت هوش مصنوعی در بهینهسازی تصمیمگیری در مکانیزمهای مالی هستند.

۲. هوش مصنوعی به عنوان ابزار رابط کاربر: رابطهای مبتنی بر هوش مصنوعی میتوانند تجربه کاربر را در زمینه ارزهای دیجیتال به طور قابل توجهی بهبود بخشند. از تشخیص تقلب تا تحلیل تراکنش، هوش مصنوعی به عنوان یک همافزا در امنیت و درک کاربر عمل میکند.

۳. هوش مصنوعی به عنوان عناصر معماری: ادغام هوش مصنوعی در معماریهای بلاک چین چالشهای جدیدی را در حفظ شفافیت و محافظت در برابر حملات متخاصم ایجاد میکند. توازن بین نوآوری و امنیت برای بهرهبرداری از این پتانسیل بسیار مهم است.

۴. هوش مصنوعی به عنوان اهداف اصلی: توسعه سیستمهای غیرمتمرکز هوش مصنوعی از طریق بلاک چین، پتانسیل تحول عظیمی را به همراه دارد. با این حال، برای مواجهه با پیچیدگیهای رمزنگاری و اطمینان از مکانیزمهای حاکمیای در خطرات و تقویت پذیرش گسترده، نیاز به احتیاط لازم است.

از رباتهای آربیتراژ تا بازارهای پیشبینی، نقش هوش مصنوعی در بهبود فرآیندهای تصمیمگیری در اکوسیستمهای بلاک چین در حال رشد است. با این حال، تضمین تعاملات منصفانه و شفاف در میان شرایط پویای بازار همچنان یک چالش بزرگ است.

رابطهای مبتنی بر هوش مصنوعی، بهبود درک کاربر و محافظت در برابر فعالیتهای تقلبی را فراهم میکنند. با این حال، احتیاط لازم برای کاهش خطرات سوءاستفاده و خطاها، به ویژه در زمینههای متخاصم، ضروری است.

نظریه Vitalik Buterin در مورد هوش مصنوعی در سال ۲۰۲۴ -۱

توسعه سیستمهای هوش مصنوعی غیرمتمرکز از طریق بلاک چین، پتانسیل تحولآفرین بسیار زیادی دارد. با این حال، برای پیمایش پیچیدگیهای رمزنگاری و اطمینان از مکانیزمهای حاکمیتی قوی برای کاهش خطرات و تقویت پذیرش گسترده، ضروری است.

هرچند چشمانداز هوش مصنوعی غیرمتمرکز و قابل اعتماد جذاب است، اما چالشهای بزرگی وجود دارد. برای مواجهه با این پیچیدگیها و درک کامل پتانسیل راهحلهای بلاک چین با هوش مصنوعی، نیاز به آزمایش کامل و استقرار محتاطانه وجود دارد.

در واقع، بیانیه بوترین تأکید میکند که در تلاقی رمزنگاری و هوش مصنوعی که در حال تحول است، باید با دقت به برنامههای کاربردی جدید و محافظت در برابر خطرات نوظهور پیش برویم. او از سهامداران خواسته است تا در این فرایند، با دقت و مراقبت عمل کنند.

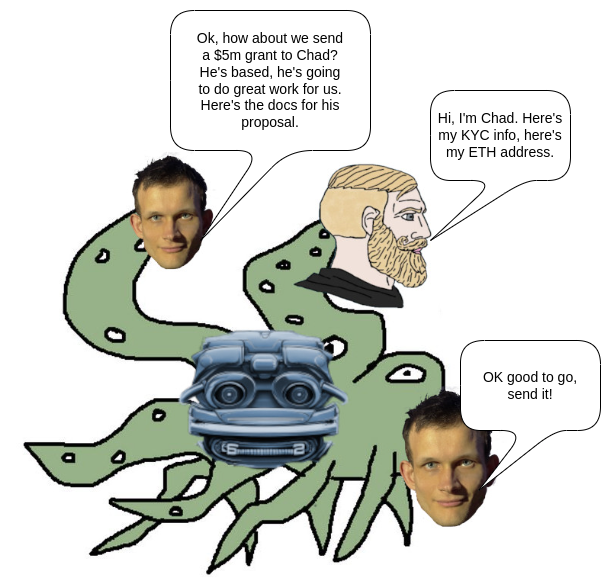

چالش های Deepfake

اخیراً، Buterin به تهدید فزاینده فناوری دیپ فیک در زمینههای امنیتی اشاره کرده است و بر ضرورت اقدامات امنیتی تطبیقی با توجه به پیچیدگی روزافزون دیپ فیک ها تأکید داشته است.

بوترین، ادغام سؤالات امنیتی، استفاده از کلمات رمز از پیش توافق شده و استفاده از کلید فشار را به عنوان اقدامات متقابل واکنشگرا در برابر دستکاری عمیق دروغین پیشنهاد داده است. علاوه بر این، او توصیه کرده است اجرای تاخیرهای تراکنش برای اقدامات غیرقابل برگشت را پیشنهاد دهد تا امکان تأیید و مداخله در برابر این نوع تهدیدات مهیا شود.

نظریه Vitalik Buterin در مورد هوش مصنوعی در سال ۲۰۲۴ -۲

با تطبیق فعالانه استراتژیهای امنیتی برای مبارزه با ماهیت در حال تحول تهدیدات دیپفیک، افراد و سازمانها میتوانند بهتر از خود در برابر فعالیتهای کلاهبرداری در یک محیط فریبنده دیجیتال محافظت کنند.

هوش مصنوعی و خوش بینی فنی

در یک پست نوامبر با عنوان “چالشهای هوش مصنوعی از منظر امیدواری من”، ویتالیک به چالشهای هوش مصنوعی در رابطه با نگرش جامعه به توسعه سریع فناوری پرداخت کرده است.

او تاکید میکند که برخی از فناوریها قادرند اثرات منفی را کاهش دهند. اما، جهان عادت دارد که برخی حوزههای خاص توسعه فناوری را در اولویت قرار دهد و به سایر زمینهها بیتوجهی کند. ویتالیک با تأکید بر اهمیت فعالیت انسانها در هدایت فناوری به سمت جهتهای مطلوب، بیان میکند که تنها اتکا به حداکثر سود به طور طبیعی نمیتواند به نتایج مطلوب منجر شود.

در مقالهی Buterin، علاوه بر این، به خطرات وجودی، پیامدهای اجتماعی و نقش دولت در چالشهای آینده نیز پرداخته شده است.

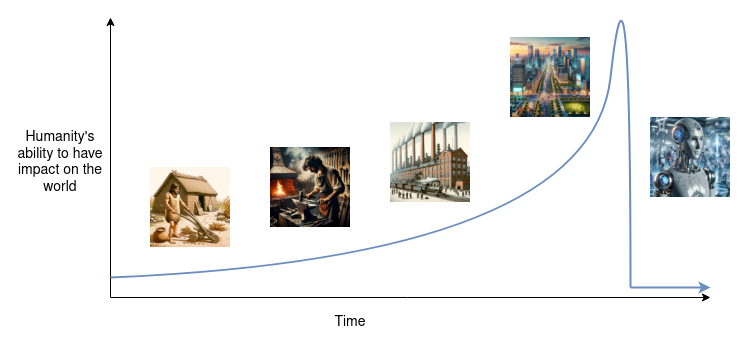

هوش مصنوعی به عنوان یک نیروی دگرگون کننده در نظر گرفته میشود. هوش مصنوعی تنها یک فناوری معمولی نیست، بلکه یک نیروی دگرگون کننده است که پیامدهای اجتماعی مهمی دارد، مانند اختراعات گذشته مانند ماشین چاپ یا انقلاب صنعتی.

سلطه بالقوه هوش مصنوعی نیز مورد بررسی قرار میگیرد. هوش مصنوعی نوعی هوش جدید را نشان میدهد که به طور نظری میتواند از هوش انسانی پیشی بگیرد و به طور غالب در جامعه ظاهر شود، مشابه جهشهای تکاملی قبلی مانند زندگی چند سلولی که از زندگی تک سلولی برخاسته است.

همچنین، توسعه هوش مصنوعی خطرات وجودی را در بر دارد. اگر هوش مصنوعی تصمیم بگیرد به ضرر بشریت عمل کند، میتواند منجر به انقراض انسان شود. این هوش مصنوعی ممکن است به عنوان یک ابزار همگرا اقدام کرده و منابع و ایمنی خود را در اولویت قرار دهد و برای بشریت تهدیدی باشد.

چالشهای حاکمیتی نیز در این مقاله مورد بررسی قرار میگیرند. ساختارهای حاکمیتی، از جمله تلاش OpenAI برای ایجاد تعادل بین انگیزههای سود و مدیریت ریسک، با نقدهایی مواجه شدهاند به دلیل عدم شفافیت و پاسخگویی. ساختارهای قدرت متمرکز میتوانند به جای کاهش خطرات مرتبط با توسعه هوش مصنوعی، آنها را تشدید کنند.

به جای اینکه تکیه بر ساختارهای قدرت متمرکز باشد، در این مقاله به راهکارهای دموکراتیک برای مدیریت ریسک اشاره شده است. یک رویکرد دموکراتیکتر میتواند مانند فلسفه d/acc، بهترین راهحلها را برای مقابله با خطرات ناشی از هوش مصنوعی و سایر تهدیدات وجودی ارائه دهد.

منبع: u.today

نظرات کاربران